Quando il codice fallisce: i bug più costosi della storia

Nel corso della storia dell’informatica, i bug a volte sono stati veramente costosi: veri e propri eventi in grado di influenzare mercati finanziari, missioni spaziali e infrastrutture critiche. Dietro ogni errore si nasconde una combinazione di fretta, complessità e, spesso, eccessiva fiducia nei sistemi automatizzati.

Analizzare questi casi non è solo un esercizio di memoria, ma un modo per comprendere quanto sia delicato l’equilibrio tra innovazione e controllo. Perché se è vero che il software governa il mondo moderno, è altrettanto vero che basta un difetto invisibile per mandarlo in crisi.

Scopriamo quindi i bug più costosi della storia dell’informatica.

Il crash del Mars Climate Orbiter

Uno degli esempi più celebri di bug costosi arriva direttamente dalla NASA. Nel 1999, la sonda Mars Climate Orbiter andò distrutta durante l’ingresso nell’atmosfera marziana a causa di un errore apparentemente banale: un’incompatibilità tra unità di misura.

Un team utilizzava il sistema imperiale, mentre un altro lavorava con il sistema metrico. Il risultato fu una traiettoria completamente errata che portò alla perdita della sonda, con un danno stimato di oltre 300 milioni di dollari. Un errore di conversione, in un contesto ad altissima complessità, si trasformò in una lezione globale sull’importanza degli standard.

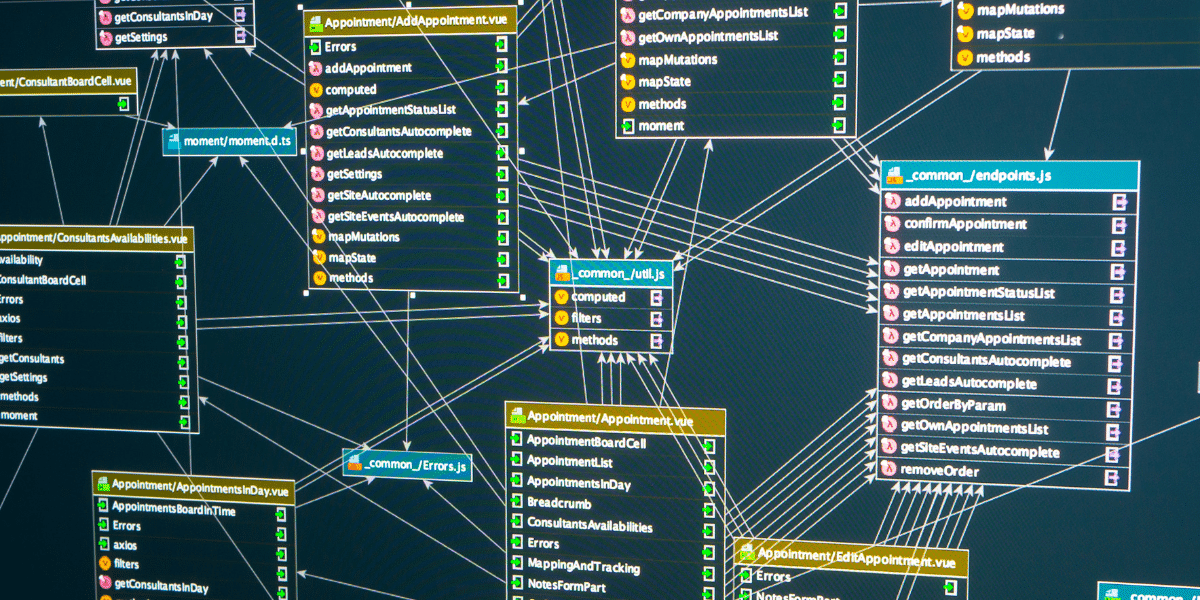

Il bug del Knight Capital Group

Nel 2012, Knight Capital Group, una delle principali società di trading negli Stati Uniti, subì una perdita di circa 440 milioni di dollari in meno di un’ora. Il motivo fu un aggiornamento software mal gestito che attivò un vecchio sistema di test su mercati reali.

Il codice iniziò a inviare ordini automatici errati, generando un effetto a catena devastante. In pochi minuti, la società si trovò sull’orlo del fallimento. Questo episodio dimostrò quanto i sistemi finanziari, altamente automatizzati, possano essere vulnerabili a errori software non adeguatamente controllati.

Ariane 5: quando il riuso del codice diventa un rischio

Nel 1996, il lancio del razzo Ariane 5 si concluse con un’esplosione pochi secondi dopo il decollo. Il problema derivava da un errore nel software di navigazione, riutilizzato da una versione precedente del razzo.

Il codice non era stato adattato correttamente alle nuove condizioni operative e generò un overflow che portò al fallimento del sistema. Il costo del disastro superò i 370 milioni di dollari. Questo caso evidenziò un paradosso: il riuso del codice, spesso considerato una best practice, può diventare un rischio se non accompagnato da adeguati controlli.

Il blackout del 2003 in Nord America

Non tutti i bug colpiscono direttamente aziende o missioni spaziali. Alcuni hanno impatti su larga scala, come il blackout del 2003 che lasciò senza elettricità oltre 50 milioni di persone tra Stati Uniti e Canada.

Una delle cause principali fu un errore software nel sistema di monitoraggio della rete elettrica, che non segnalò correttamente un guasto. Senza allarmi tempestivi, la situazione degenerò fino al collasso della rete. I danni economici furono stimati in miliardi di dollari, dimostrando quanto sia cruciale l’affidabilità dei sistemi critici.

L’errore di AT&T e il collasso della rete

Nel 1990, una rete telefonica gestita da AT&T subì un’interruzione massiva che lasciò milioni di utenti senza servizio per ore. Il problema fu causato da un singolo errore nel codice di gestione delle chiamate.

Un bug nella gestione delle eccezioni generò un effetto domino tra i nodi della rete, causando il riavvio continuo dei sistemi. Anche in questo caso, un piccolo errore logico si trasformò in un disservizio su scala nazionale, con costi enormi sia economici che reputazionali.

Le lezioni che non possiamo ignorare

Questi esempi, pur diversi tra loro, condividono un elemento comune: la sottovalutazione del rischio. In molti casi, il problema non è stato solo il bug in sé, ma la mancanza di controlli adeguati, test insufficienti o una gestione poco attenta degli aggiornamenti.

Nel mondo contemporaneo, dove il software è alla base di quasi ogni attività, la qualità del codice non è più un dettaglio tecnico, ma una responsabilità strategica. Le aziende investono sempre di più in testing, sicurezza e monitoraggio, ma il rischio zero non esiste.

Il futuro tra automazione e responsabilità

Con l’avvento dell’intelligenza artificiale e degli strumenti di sviluppo automatico, il rischio di bug non scompare, ma cambia forma. Se da un lato l’AI può ridurre gli errori umani, dall’altro introduce nuove complessità legate alla comprensione e alla verifica del codice generato.

Gli sviluppatori del futuro dovranno quindi assumere un ruolo ancora più critico, non solo nella scrittura del codice, ma nella sua validazione e supervisione. La capacità di prevenire errori sarà tanto importante quanto quella di risolverli.

Questo contenuto è stato realizzato nel rispetto dei principi di trasparenza e tracciabilità previsti dal Regolamento Europeo AI Act (2025). Tipo di contenuto: AI-assisted