Il futuro della programmazione sotto pressione normativa

Per molti anni il mondo dello sviluppo software è stato raccontato come uno spazio libero, veloce, quasi anarchico. I programmatori costruivano applicazioni seguendo soprattutto logiche tecniche e di mercato, con una regolamentazione minima e spesso in ritardo rispetto all’innovazione. Oggi quello scenario sta cambiando rapidamente. Le normative stanno entrando nel cuore della produzione tecnologica e stanno trasformando il modo stesso in cui il software viene progettato, scritto e distribuito.

L’esplosione dell’intelligenza artificiale, la crescente attenzione alla privacy e la necessità di proteggere infrastrutture digitali sempre più strategiche hanno spinto governi e istituzioni a intervenire con regole più severe. L’Europa ha aperto la strada con il GDPR e l’AI Act, mentre Stati Uniti, Cina e altri grandi attori globali stanno definendo modelli normativi differenti ma ugualmente incisivi. In questo nuovo contesto, programmare non significa più soltanto creare codice efficiente: significa anche interpretare vincoli legali, responsabilità etiche e requisiti di conformità.

Questa trasformazione non rappresenta soltanto un ostacolo burocratico. Per molti aspetti sta ridefinendo il ruolo dello sviluppatore, il rapporto tra aziende e tecnologia e persino il concetto di innovazione. Il futuro della programmazione si giocherà sempre di più nella capacità di trovare equilibrio tra creatività tecnica e pressione normativa, in un ecosistema dove ogni riga di codice potrebbe avere implicazioni legali, economiche e sociali.

La fine dell’epoca “move fast and break things”

Per oltre un decennio il settore tecnologico ha vissuto seguendo una filosofia precisa: innovare rapidamente, conquistare il mercato e affrontare eventuali problemi solo in un secondo momento. Questo approccio ha permesso la nascita di piattaforme globali, startup miliardarie e servizi digitali capaci di cambiare radicalmente le abitudini delle persone.

Oggi però la situazione è profondamente diversa. Le conseguenze sociali della tecnologia sono diventate troppo evidenti per essere ignorate. Violazioni massive dei dati personali, algoritmi discriminatori, campagne di disinformazione automatizzata e sistemi di intelligenza artificiale poco trasparenti hanno spinto le istituzioni a chiedere maggiore controllo.

Per gli sviluppatori questo significa lavorare in un ambiente meno permissivo. La velocità continua a essere importante, ma non può più prevalere sulla sicurezza, sulla trasparenza e sulla conformità normativa. Ogni progetto deve tenere conto fin dall’inizio di aspetti che un tempo venivano affrontati solo nelle fasi finali, o addirittura ignorati.

Il programmatore del futuro sarà anche un interprete normativo

La figura del developer sta evolvendo rapidamente. In passato era sufficiente possedere solide competenze tecniche per costruire software competitivo. Nel prossimo futuro, invece, sarà sempre più necessario comprendere regolamenti, standard internazionali e responsabilità legali.

Questo cambiamento è già evidente nei grandi team di sviluppo, dove ingegneri software, legali e specialisti di compliance lavorano fianco a fianco. Le aziende chiedono agli sviluppatori di conoscere temi come gestione dei dati, tracciabilità degli algoritmi, cybersecurity e governance dell’intelligenza artificiale.

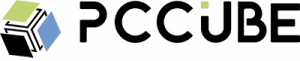

Non si tratta semplicemente di aggiungere nuove competenze teoriche. Le normative stanno modificando concretamente il modo in cui il codice viene scritto. Pensiamo alla necessità di documentare il funzionamento di un algoritmo AI, oppure all’obbligo di garantire la cancellazione completa dei dati personali di un utente. Dietro questi requisiti ci sono scelte architetturali precise, che influenzano database, infrastrutture cloud e processi di sviluppo.

L’intelligenza artificiale come nuovo terreno di scontro

Nessun settore sta subendo la pressione normativa quanto quello dell’intelligenza artificiale. L’enorme diffusione dei modelli generativi ha acceso un dibattito globale sulla necessità di controllare strumenti capaci di produrre contenuti, prendere decisioni automatizzate e influenzare la vita delle persone.

L’AI Act europeo rappresenta uno dei primi tentativi concreti di regolamentare questo ecosistema. La logica è chiara: maggiore è il rischio associato a un sistema AI, maggiore deve essere il livello di controllo. Questo approccio obbligherà le aziende a introdurre audit, sistemi di monitoraggio e documentazione dettagliata per dimostrare la conformità dei propri modelli.

Per gli sviluppatori di AI il cambiamento sarà radicale. Non basterà più ottenere performance elevate o ridurre i tempi di inferenza. Sarà necessario dimostrare che il modello è trasparente, controllabile e sicuro. In alcuni casi diventerà indispensabile spiegare come un algoritmo è arrivato a una determinata decisione, aprendo nuove sfide tecniche nel campo della cosiddetta explainable AI.

Open source e regolamentazione: un equilibrio delicato

Il mondo open source potrebbe trovarsi davanti a una delle trasformazioni più complesse della sua storia. Molte normative nascono pensando alle grandi aziende tecnologiche, ma rischiano di avere conseguenze indirette anche sulle comunità indipendenti che sviluppano software libero.

Uno dei temi più discussi riguarda la responsabilità. Se un framework open source viene utilizzato per creare un sistema non conforme alle normative, chi ne risponde? Gli sviluppatori della libreria? L’azienda che la utilizza? Oppure nessuno? Le risposte non sono ancora definitive e questo genera incertezza.

Allo stesso tempo, però, l’open source potrebbe diventare uno strumento fondamentale per garantire trasparenza. I governi e le istituzioni potrebbero preferire sistemi verificabili pubblicamente rispetto a piattaforme completamente chiuse. Questo aprirebbe nuove opportunità per le community che sapranno adattarsi a standard di sicurezza e documentazione più rigorosi.

La cybersecurity diventerà parte integrante dello sviluppo

La pressione normativa sta accelerando anche l’integrazione tra sviluppo software e sicurezza informatica. Per anni la cybersecurity è stata trattata come una fase separata del processo produttivo. Oggi questa distinzione sta scomparendo.

Normative sempre più severe obbligano le aziende a dimostrare di aver adottato misure adeguate a proteggere dati e infrastrutture. Questo significa che la sicurezza dovrà essere incorporata direttamente nel ciclo di sviluppo, attraverso pratiche DevSecOps, controlli automatici e verifiche continue del codice.

Nel futuro prossimo, uno sviluppatore che ignora i principi di sicurezza rischierà di essere rapidamente escluso dal mercato. Le competenze richieste comprenderanno gestione delle vulnerabilità, crittografia, autenticazione avanzata e protezione delle API. La programmazione non sarà più soltanto una disciplina creativa, ma anche una forma di responsabilità operativa.

La frammentazione normativa globale

Uno degli aspetti più complessi riguarda la mancanza di un modello normativo unico a livello internazionale. L’Europa punta fortemente sulla tutela dei diritti digitali e sulla protezione dei dati personali. Gli Stati Uniti adottano un approccio più orientato al mercato e all’innovazione. La Cina, invece, utilizza la regolamentazione anche come strumento di controllo strategico e geopolitico.

Per le aziende software questo scenario rappresenta una sfida enorme. Un’applicazione globale potrebbe dover rispettare regole completamente diverse a seconda del Paese in cui viene distribuita. Di conseguenza, gli sviluppatori dovranno progettare architetture flessibili, capaci di adattarsi a requisiti normativi differenti.

La programmazione diventerà quindi sempre più legata al contesto geografico e politico. Non esisterà più un software universale valido ovunque allo stesso modo. Il codice dovrà essere pensato anche in funzione delle giurisdizioni in cui verrà utilizzato.

Il rischio di rallentare l’innovazione

Naturalmente esiste anche il rischio opposto: un eccesso di regolamentazione potrebbe soffocare l’innovazione. Startup e piccoli team potrebbero non avere le risorse necessarie per affrontare costi di compliance sempre più elevati. Questo potrebbe favorire le grandi aziende, che dispongono di uffici legali e infrastrutture dedicate.

Molti sviluppatori temono che il settore tecnologico possa perdere quella velocità sperimentale che ha caratterizzato gli ultimi vent’anni. Ogni nuovo obbligo burocratico introduce tempi più lunghi, controlli più complessi e maggiore prudenza nelle decisioni tecniche.

Tuttavia, esiste anche una visione differente. Alcuni osservatori ritengono che regole chiare possano creare un ecosistema più stabile e affidabile, aumentando la fiducia degli utenti e delle imprese nei confronti delle tecnologie emergenti. In questa prospettiva, la normativa non sarebbe un freno all’innovazione, ma una condizione necessaria per renderla sostenibile nel lungo periodo.

Conclusione

Il futuro della programmazione sarà inevitabilmente influenzato dalla pressione normativa. Gli sviluppatori dovranno abituarsi a lavorare in un contesto dove tecnologia, diritto ed etica saranno sempre più intrecciati. La scrittura del codice non potrà più essere separata dalle conseguenze sociali e legali dei software prodotti.

Questa trasformazione cambierà il mercato del lavoro, le competenze richieste e il modo stesso di concepire l’innovazione digitale. I programmatori del futuro non saranno soltanto tecnici, ma figure ibride capaci di muoversi tra algoritmi, sicurezza, governance e compliance.

In definitiva, la sfida più importante non sarà fermare la regolamentazione né accettarla passivamente. Sarà trovare un equilibrio intelligente tra libertà creativa e responsabilità collettiva. È in questo equilibrio che si giocherà il vero futuro della programmazione.